Sommaire

- 1 Introduction

- 2 Le cadre juridique général de l’utilisation de l’IA en entreprise : une approche multiniveau

- 3 Quelles obligations pour l’employeur face à l’IA au travail ?

- 4 Déployeur ou fournisseur d’IA : une frontière juridique particulièrement fragile

- 5 Quelles mesures les entreprises doivent-elles prendre pour encadrer l’IA ?

- 6 Conclusion

- 7 FAQ

Introduction

L’intelligence artificielle (IA) connaît une diffusion rapide au sein des entreprises. Automatisation de tâches, aide à la prise de décision, génération de contenus, optimisation des processus internes : les usages se multiplient, souvent à l’initiative des salariés eux-mêmes, dans un contexte de forte accessibilité des outils.

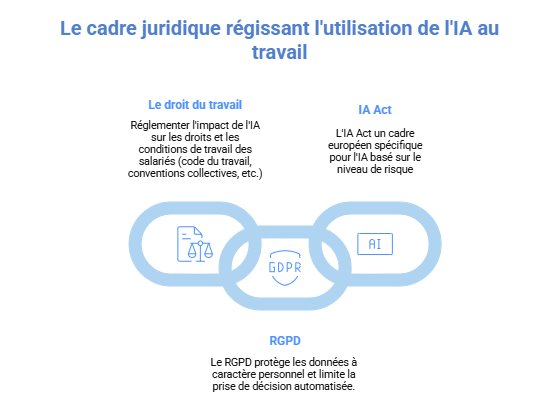

Cette adoption rapide peut donner l’illusion d’une liberté d’usage. En réalité, l’utilisation de l’IA au travail s’inscrit dans un cadre juridique dense et désormais structuré, issu de la combinaison du droit du travail, du règlement général sur la protection des données (RGPD), des conventions collectives de travail (CCT) et, plus récemment, du règlement européen sur l’intelligence artificielle (AI Act).

L’IA n’est donc ni un outil neutre, ni un simple instrument technique. Elle ne peut pas être utilisée librement au travail, dès lors qu’elle affecte l’organisation, les droits des salariés ou le traitement des données.

Le cadre juridique général de l’utilisation de l’IA en entreprise : une approche multiniveau

L’usage de l’IA au travail repose sur un enchevêtrement de normes nationales et européennes qui s’appliquent pleinement dès lors qu’un outil algorithmique influence l’organisation du travail, la prise de décision ou le traitement de données personnelles.

L’IA Act : Un nouveau pilier, mais non autonome

Le règlement (UE) 2024/1689 sur l’intelligence artificielle (AI Act), adopté en juin 2024, constitue le premier cadre juridique européen spécifiquement dédié à l’IA. Il introduit une approche fondée sur le niveau de risque des systèmes utilisés.

Sont notamment qualifiés de systèmes d’IA à haut risque ceux utilisés pour :

- Le recrutement et la sélection des candidats,

- L’évaluation ou la notation des salariés,

- La gestion des performances,

- La surveillance ou le contrôle des comportements professionnels.

Le règlement impose, dès à présent pour certaines dispositions, des obligations structurantes aux employeurs, parmi lesquelles :

- L’interdiction de certaines pratiques d’IA jugées incompatibles avec les droits fondamentaux ;

- L’obligation de garantir une formation appropriée des personnes amenées à utiliser des systèmes d’IA.

Toutefois, les retours d’expérience montrent que l’AI Act ne saurait être appréhendé isolément : il s’inscrit dans un cadre juridique préexistant qui continue de produire pleinement ses effets.

Le RGPD : Le socle juridique central de l’IA au travail

Dans la quasi-totalité des cas, l’IA utilisée en entreprise implique un traitement de données personnelles. Le RGPD constitue donc le point d’entrée juridique incontournable.

L’employeur conserve, en principe, la qualité de responsable de traitement, y compris lorsque l’outil d’IA est fourni par un prestataire tiers. À ce titre, il lui appartient notamment de :

- Définir une finalité précise, explicite et légitime ;

- Identifier une base légale valable ;

- Respecter les principes de minimisation, de proportionnalité et de sécurité ;

- Assurer une information claire et transparente des salariés.

La CNIL rappelle régulièrement que les systèmes algorithmiques ne sauraient échapper aux exigences fondamentales de protection des droits des personnes.

Le RGPD encadre par ailleurs strictement les décisions fondées exclusivement sur des traitements automatisés produisant des effets juridiques ou significatifs. En pratique, l’intervention humaine demeure un impératif, notamment dans les processus de recrutement, d’évaluation ou de sanction.

Le droit du travail et les conventions collectives : un encadrement social déterminant

Au-delà des textes européens, le droit du travail et les conventions collectives de travail (CCT) jouent un rôle central dans l’encadrement de l’IA en entreprise.

L’IA est juridiquement assimilée à une nouvelle technologie de travail, ce qui déclenche, dans de nombreux secteurs, des obligations spécifiques d’information et de consultation des représentants du personnel.

Les conventions collectives encadrent fréquemment :

- L’introduction de nouvelles technologies affectant l’organisation ou les conditions de travail ;

- Les dispositifs de contrôle, de surveillance ou d’évaluation des salariés ;

- Les mesures susceptibles d’avoir un impact sur l’emploi, les compétences ou les méthodes de management.

Ainsi, un projet d’IA peut être conforme au RGPD et à l’AI Act, tout en étant juridiquement fragilisé s’il méconnaît les obligations conventionnelles applicables. Ce niveau d’encadrement reste encore trop souvent sous-estimé par les entreprises.

Quelles obligations pour l’employeur face à l’IA au travail ?

L’employeur peut recourir à l’IA pour organiser le travail, améliorer la performance ou sécuriser les processus internes, à condition de respecter un principe fondamental : la responsabilité décisionnelle demeure humaine.

L’IA peut assister, éclairer ou automatiser certaines tâches, mais elle ne peut jamais se substituer à la responsabilité de l’employeur, tant à l’égard des salariés que des autorités de contrôle.

L’usage croissant des outils d’IA générative soulève, en outre, un risque spécifique : la divulgation involontaire de données personnelles ou confidentielles via les prompts. Ces données peuvent être traitées hors de l’Union européenne ou réutilisées à des fins d’entraînement des modèles.

Les employeurs doivent donc :

- Encadrer strictement les usages autorisés,

- Former les salariés aux risques juridiques,

- Sélectionner des prestataires offrant des garanties élevées en matière de confidentialité et de sécurité.

Déployeur ou fournisseur d’IA : une frontière juridique particulièrement fragile

L’un des apports structurants de l’AI Act réside dans la distinction entre déployeur et fournisseur d’IA.

En apparence, la distinction est simple :

- Le fournisseur conçoit ou met sur le marché un système d’IA ;

- Le déployeur utilise ce système dans le cadre de son activité professionnelle.

En pratique, l’AI Act adopte une approche fonctionnelle. Un employeur peut être qualifié de fournisseur dès lors qu’il dépasse une utilisation passive de l’outil, notamment lorsqu’il :

- Entraîne ou réentraîne un modèle sur ses propres données internes ;

- Modifie les paramètres de fonctionnement ;

- Intègre l’IA dans un système décisionnel interne ;

- Combine plusieurs outils pour créer une solution algorithmique propre.

Ces situations sont fréquentes dans les projets RH, de conformité ou de pilotage de la performance, et emportent des obligations renforcées en matière de gouvernance, de documentation et de gestion des risques.

Quelles mesures les entreprises doivent-elles prendre pour encadrer l’IA ?

Pour sécuriser l’usage de l’IA au travail, les entreprises doivent mettre en place une gouvernance juridique et organisationnelle claire, reposant notamment sur :

- Une charte interne d’utilisation de l’IA ;

- Des règles précises de gestion des données et des prompts ;

- Une formation des équipes aux risques juridiques ;

- Un encadrement contractuel rigoureux des fournisseurs d’IA.

Cette approche permet de réduire significativement les risques contentieux, de renforcer la conformité réglementaire et d’instaurer un climat de confiance avec les salariés.

Conclusion

L’intelligence artificielle constitue un outil puissant, mais elle ne peut être utilisée au travail de manière libre ou incontrôlée. Son usage engage directement la responsabilité de l’employeur et suppose une maîtrise juridique aussi rigoureuse que la maîtrise technique.

Une stratégie claire, associée à des règles internes adaptées, est indispensable pour concilier innovation, performance et sécurité juridique. L’encadrement de l’IA au travail impose une approche globale, intégrant le RGPD, le droit du travail, les conventions collectives, la propriété intellectuelle et le règlement européen sur l’intelligence artificielle.

Le cabinet Dreyfus et Associés est en partenariat avec un réseau mondial d’avocats spécialisés en Propriété Intellectuelle.

Nathalie Dreyfus avec l’aide de toute l’équipe du cabinet Dreyfus

FAQ

1. L’employeur est-il responsable des décisions prises par une IA ?

Oui. L’employeur demeure pleinement responsable des décisions prises au sein de l’entreprise, même lorsque celles-ci sont assistées ou préparées par un système d’IA. L’IA peut constituer un outil d’aide à la décision, mais elle ne peut jamais se substituer à la responsabilité humaine, notamment en matière de recrutement, d’évaluation ou de sanction des salariés.

2. L’AI Act remplace-t-il le RGPD et le droit du travail ?

Non. L’AI Act ne se substitue ni au RGPD ni au droit du travail. Il vient compléter un cadre juridique existant. Un même outil d’IA peut être soumis simultanément à l’AI Act, au RGPD, aux règles du droit du travail et aux conventions collectives, ce qui impose une lecture croisée et une approche globale de la conformité.

3. Un salarié peut-il refuser d’utiliser un outil d’IA imposé par l’employeur ?

En principe, le salarié est tenu d’exécuter les directives de l’employeur relevant de son pouvoir de direction. Toutefois, un refus peut être légitime si l’outil d’IA n’a pas été correctement porté à la connaissance des salariés, s’il porte atteinte à leurs droits fondamentaux, ou s’il n’a pas fait l’objet des consultations obligatoires des représentants du personnel. L’absence de formation ou une utilisation contraire aux règles de protection des données peut également fragiliser la légitimité de l’outil.

4. Que se passe-t-il si un salarié utilise un outil d’IA non autorisé dans son travail ?

L’utilisation d’un outil d’IA non autorisé peut constituer un manquement aux obligations professionnelles, notamment en matière de confidentialité et de sécurité des données. Toutefois, toute sanction suppose que les règles applicables aient été clairement définies, portées à la connaissance des salariés et proportionnées. En l’absence de charte ou de politique interne, la marge de manœuvre disciplinaire de l’employeur est réduite.

5. Un salarié peut-il revendiquer des droits de propriété intellectuelle sur un contenu généré avec l’aide de l’IA ?

Oui, mais dans des cas très limités. Un salarié ne peut revendiquer des droits de propriété intellectuelle sur un contenu généré avec l’aide de l’IA que si son intervention humaine est créative, déterminante et identifiable. À défaut d’un apport intellectuel personnel (choix créatifs, structuration, modification substantielle du contenu), le résultat produit par l’IA n’est pas protégeable par le droit d’auteur. En outre, lorsque le contenu est créé dans le cadre des fonctions du salarié, les droits d’exploitation appartiennent en principe à l’employeur ou sont encadrés contractuellement.

Cette publication a pour objet de fournir des orientations générales au public et de mettre en lumière certaines problématiques. Elle n’a pas vocation à s’appliquer à des situations particulières ni à constituer un conseil juridique.