Sommaire

- 1 Introduction

- 2 Une mutation du cadre réglementaire de l’IA en 2026

- 3 La formalisation obligatoire de la gestion des risques

- 4 L’accroissement des exigences de transparence et d’explicabilité

- 5 Le renforcement des exigences de sécurité et de protection des utilisateurs dans les systèmes d’IA

- 6 Les enjeux persistants de propriété intellectuelle

- 7 Conclusion

- 8 FAQ :

Introduction

L’année 2026 constitue une étape charnière dans la régulation et l’encadrement des systèmes d’intelligence artificielle. Après plusieurs années marquées par des principes directeurs et des stratégies nationales, le droit de l’IA entre désormais dans une phase de normativité contraignante, notamment avec l’entrée en application progressive du règlement européen sur l’intelligence artificielle (AI Act). Dans le même temps, l’adoption massive de l’IA par les entreprises, en particulier des systèmes génératifs et des agents autonomes, accroît considérablement les risques juridiques, techniques et réputationnels.

Dans ce contexte, gérer les risques de l’IA en 2026 suppose de dépasser les approches expérimentales pour mettre en place une gouvernance structurée, documentée et conforme aux exigences réglementaires internationales.

Une mutation du cadre réglementaire de l’IA en 2026

Le paysage réglementaire mondial de l’IA ne se limite plus à des recommandations ou à des principes éthiques, mais repose désormais sur des obligations juridiques contraignantes, applicables à grande échelle. L’Union européenne, avec le AI Act, joue un rôle moteur, mais d’autres juridictions telles que la Chine, les États-Unis, la Corée du Sud, l’Australie ou encore le Vietnam s’inscrivent dans une dynamique similaire.

L’année 2026 marque un tournant décisif car l’AI Act devient pleinement applicable, notamment les dispositions relatives aux systèmes d’IA à haut risque, ainsi que la mise en place de dispositifs tels que les bacs à sable réglementaires. Cette entrée en vigueur s’inscrit dans un contexte d’usage croissant de l’IA dans des décisions ayant un impact direct sur les droits des individus et l’accès à des services essentiels.

Dès lors, les autorités de régulation considèrent que les mécanismes informels de gouvernance ne sont plus suffisants pour prévenir les risques.

La formalisation obligatoire de la gestion des risques

À partir du 2 août 2026, la gestion des risques liés à l’IA devient une obligation centrale pour les entreprises développant ou utilisant des systèmes, en particulier à haut risque. Ces systèmes, déployés dans des domaines sensibles (sécurité, biométrie, dispositifs médicaux, éducation), sont soumis à des exigences strictes.

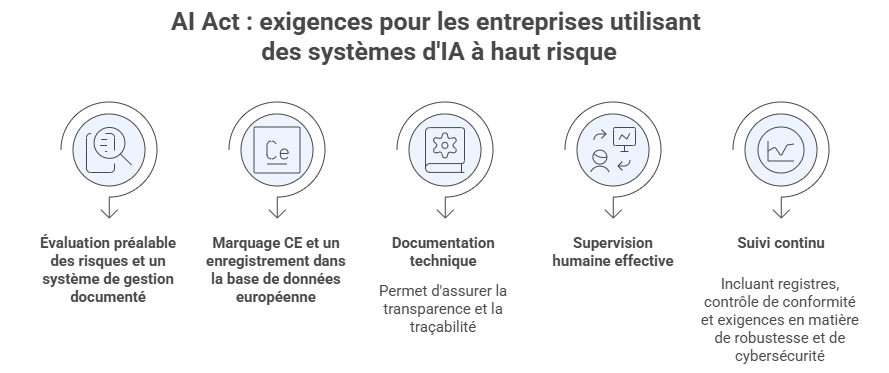

Le AI Act impose désormais aux entreprises présentant ou développant des produits intégrant des systèmes d’IA à haut risque de procéder à :

• Une évaluation préalable des risques et un système de gestion documenté ;

• Un marquage CE et un enregistrement dans la base de données européenne ;

• Une documentation technique complète, assurant transparence et traçabilité ;

• Une supervision humaine effective ;

• Un suivi continu, incluant registres, contrôle de conformité et exigences en matière de robustesse et de cybersécurité.

Ces obligations impliquent d’intégrer la gestion des risques tout au long du cycle de vie des systèmes, depuis leur conception jusqu’à leur exploitation.

Cette évolution implique également une redéfinition des responsabilités internes, avec une collaboration renforcée entre les directions juridiques, les équipes techniques et les fonctions conformité.

L’accroissement des exigences de transparence et d’explicabilité

La transparence constitue désormais un pilier central de la régulation de l’IA. Les autorités exigent que les utilisateurs soient clairement informés lorsqu’ils interagissent avec un système d’intelligence artificielle et qu’ils puissent comprendre, au moins dans ses grandes lignes, le fonctionnement des décisions automatisées.

Une décision automatisée correspond à une décision prise, en tout ou partie, par un système algorithmique sans intervention humaine directe, sur la base de données et de modèles prédictifs. Les décisions automatisées doivent être explicables, notamment dans les secteurs sensibles. Cette exigence rejoint les principes du RGPD relatifs à la transparence et au droit à l’information.

Le AI Act impose également des obligations relatives à l’identification des contenus générés par l’IA. Les utilisateurs doivent être en mesure de savoir si un contenu a été produit artificiellement, notamment dans le cas des textes, images ou vidéos générés. À cet égard, l’Office européen de l’IA offre un code de bonnes pratiques volontaire destiné à accompagner la mise en œuvre de ces obligations.

Cette évolution impose aux entreprises d’intégrer la transparence dès la conception des systèmes (« transparency by design »). Les obligations ne se limitent pas à des mentions formelles, mais impliquent une véritable réflexion sur l’information des utilisateurs et sur la lisibilité des décisions automatisées.

Le renforcement des exigences de sécurité et de protection des utilisateurs dans les systèmes d’IA

La question de la sécurité des systèmes d’IA occupe une place croissante dans les priorités réglementaires. Les risques liés aux biais algorithmiques, aux discriminations ou à l’exposition de publics vulnérables, notamment les mineurs, font l’objet d’une attention particulière.

Les autorités ont démontré, dès 2025, leur volonté d’intervenir lorsque des systèmes d’IA génèrent des contenus inappropriés ou présentent des risques pour les utilisateurs. Cette tendance se renforce en 2026 avec l’adoption de nouvelles règlementations, dans de nombreuses juridictions, imposant des obligations spécifiques en matière de protection contre les contenus dangereux ou manipulatoires.

Par ailleurs, les risques liés aux deepfakes et aux contenus générés artificiellement constituent un enjeu majeur. Ces technologies peuvent être utilisées à des fins de fraude, de harcèlement ou d’atteinte à la vie privée, conduisant plusieurs États à envisager des régulations spécifiques.

Dans ce contexte, les entreprises doivent intégrer des mécanismes de sécurité dès la conception des systèmes (« safety by design »), en testant les biais, en encadrant les usages sensibles et en renforçant les contrôles sur les contenus générés.

Les enjeux persistants de propriété intellectuelle

Enfin, la question de la propriété intellectuelle demeure au cœur des débats relatifs à l’intelligence artificielle. Les litiges portant sur l’utilisation de contenus protégés pour entraîner des modèles d’IA se multiplient, révélant des divergences d’approche entre juridictions.

Certaines décisions récentes ont reconnu que l’utilisation d’œuvres protégées sans autorisation pouvait constituer une violation du droit d’auteur, à l’image de la décision allemande GEMA v. OpenAI du 11 novembre 2025, dans laquelle le tribunal de Munich a considéré que l’entraînement de modèles sur des paroles de chansons protégées, en l’absence de licence, était illicite.

À l’inverse, d’autres juridictions adoptent une approche plus restrictive : dans l’affaire Getty Images v. Stability AI du 4 novembre 2025, la High Court of Justice de Londres a relevé qu’un modèle ne contenant pas des œuvres protégées sous une forme reconnaissable ne pouvait être assimilé à une reproduction illicite, mettant ainsi en évidence le rôle déterminant de l’analyse technique et du contexte territorial.

Pour en savoir plus concernant la décision Getty Images v. Stability AI, nous vous invitons à consulter notre article précédemment publié.

Cette incertitude juridique impose aux entreprises de sécuriser leurs pratiques, en particulier en matière de données d’entraînement, de licences et de contrôle des contenus générés. Au-delà du risque contentieux, ces enjeux touchent également à la valorisation des actifs immatériels et à la protection des innovations.

Conclusion

Gérer les risques de l’IA en 2026 implique une transformation profonde des pratiques des entreprises, qui doivent désormais intégrer les exigences juridiques, techniques et éthiques dans une approche globale et structurée. La montée en puissance des obligations réglementaires, conjuguée à la sophistication des technologies, impose une vigilance accrue et une anticipation constante des risques.

Le cabinet Dreyfus et Associés accompagne ses clients dans la gestion de dossiers de propriété intellectuelle complexes, en proposant des conseils personnalisés et un soutien opérationnel complet pour la protection intégrale de la propriété intellectuelle.

Nathalie Dreyfus avec l’aide de toute l’équipe du cabinet Dreyfus.

FAQ :

Le AI Act est-il obligatoire pour toutes les entreprises ?

Oui, dès lors qu’une entreprise développe, commercialise ou utilise un système d’IA ayant un impact dans l’UE. Les obligations dépendent toutefois du niveau de risque : elles sont beaucoup plus strictes pour les systèmes à haut risque.

Les données d’entraînement des modèles d’IA sont-elles réglementées ?

Oui. Elles doivent respecter le RGPD (licéité, transparence, finalité) et, le cas échéant, le droit d’auteur. Les entreprises doivent pouvoir justifier l’origine et l’usage des données.

Comment limiter les risques liés aux deepfakes et aux contenus générés par IA ?

Il faut combiner des outils de détection, des mécanismes de traçabilité et des règles internes strictes pour encadrer les usages et éviter la diffusion de contenus trompeurs.

Pourquoi les entreprises doivent-elles agir dès maintenant ?

Parce que les obligations entrent en application et les contrôles s’intensifient. Anticiper permet de réduire les risques juridiques et de renforcer la confiance

Quels sont les risques en cas de non-conformité ?

Les entreprises s’exposent à des amendes élevées, des interdictions ou retraits de produits, ainsi qu’à des contentieux. Le risque réputationnel est également immédiat, surtout en cas d’usage controversé de l’IA

Cette publication a pour objet de fournir des orientations générales au public et de mettre en lumière certaines problématiques. Elle n’a pas vocation à s’appliquer à des situations particulières ni à constituer un conseil juridique.